阅读了原文,ChatGPT推出了语音和图像的新能力,让用户可以用语音对话或展示图像来与ChatGPT交流。

语音交流

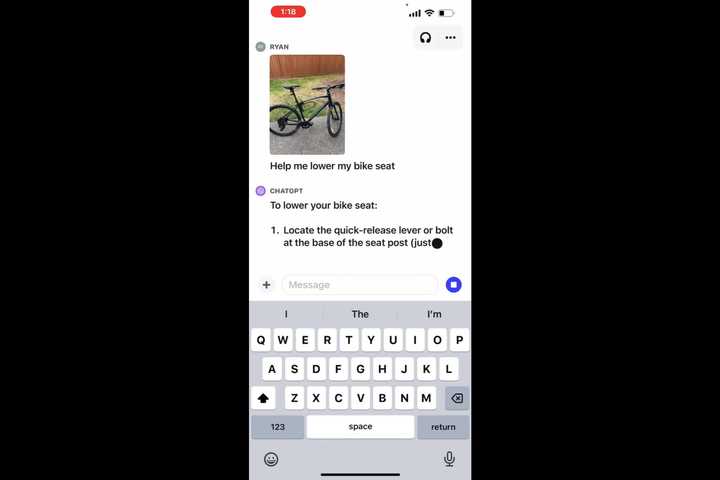

语音对话的使用方法:用户可以在移动端的设置中开启语音对话功能,然后选择自己喜欢的五种声音之一。语音对话由新的文本到语音模型和Whisper语音识别系统支持。

语音功能将在未来两周内向Plus和Enterprise用户推出,且在iOS和Android平台上提供(需要在设置中开启)。

说到语音交流,New Bing早就可以了。

此外,在ChatGPT可以使用Voice Control for ChatGPT的插件也可以实现语音功能。

但是,这次的语音交流,提供了五种音色,类似于人类的音色,还有语气,确实不错。不知道,后面可不可以实现文本转语音,再下载下来当音频使用。

官方视频:

图像理解

图像理解的使用方法:用户可以拍摄或选择一张或多张图像,让ChatGPT分析和评论。图像功能由多模态GPT-3.5和GPT-4模型驱动,这些模型可以将它们的语言推理能力应用到各种类型的图片上,如照片、截图和文本图像混合的文档。

图像理解功能也将在未来两周内向Plus和Enterprise用户推出。图像功能将在所有平台上提供。其他用户群体,如开发者,也将在不久后体验到这些功能。

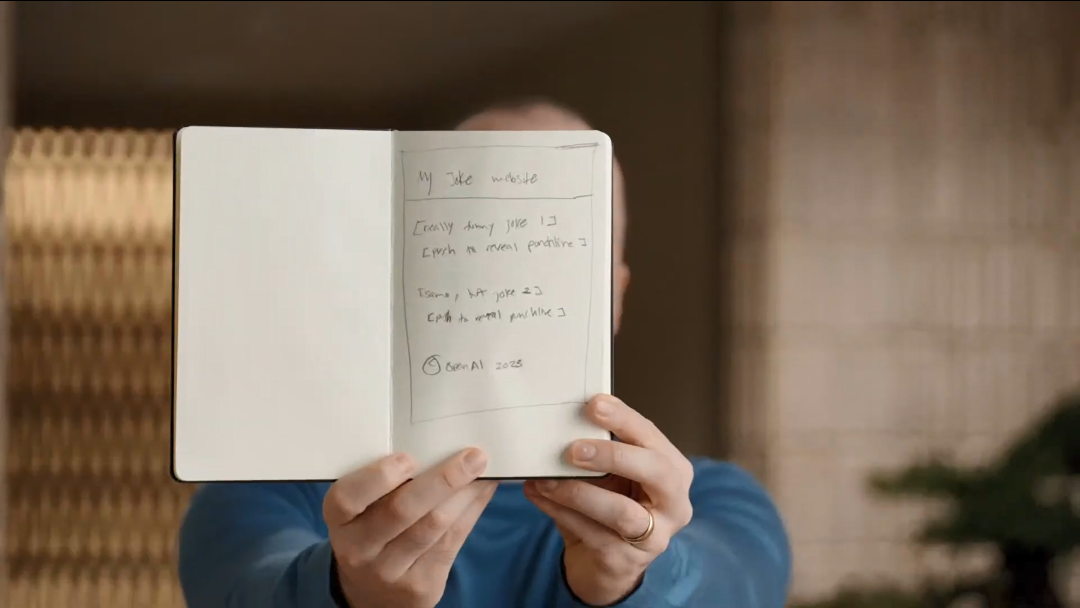

还记得GPT-4发布时,OpenAI 联合创始人 Greg Brockman 通过一个案例展示了GPT-4的图像理解能力,这次终于来了。

该案例详情:

步骤一:在本子上随意画了个网站草图,或者说是一个网站Demo(demonstration,其中文含意为示范、展示、样片、样稿,常被用来称呼具有示范或展示功能及意味的事物)。

步骤二:用手机将草图拍下来。

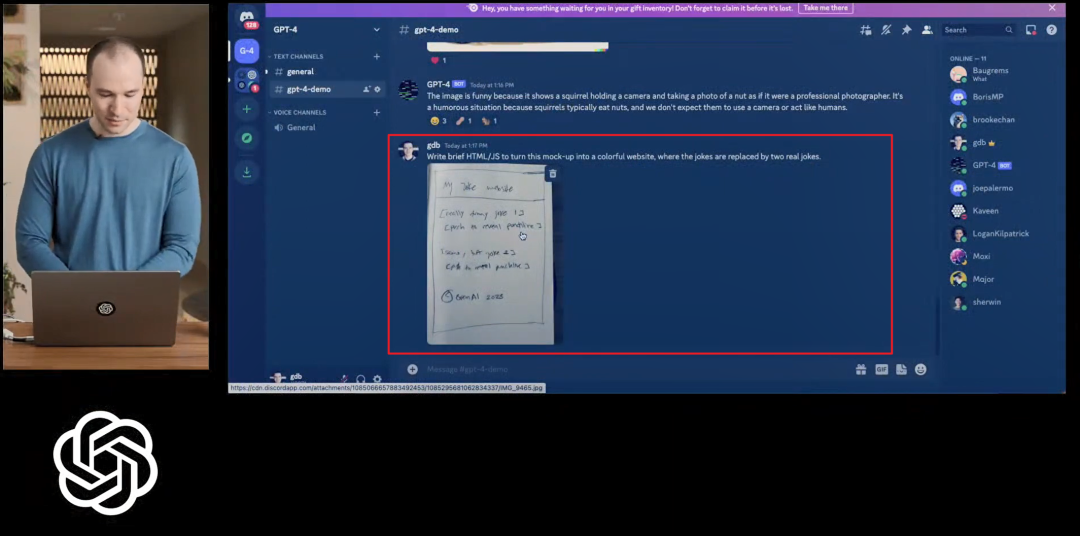

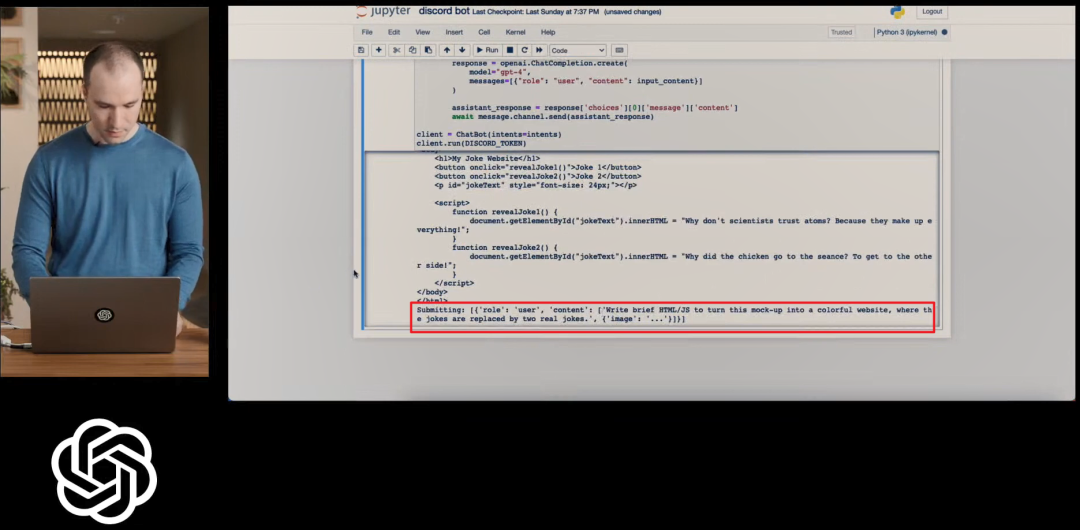

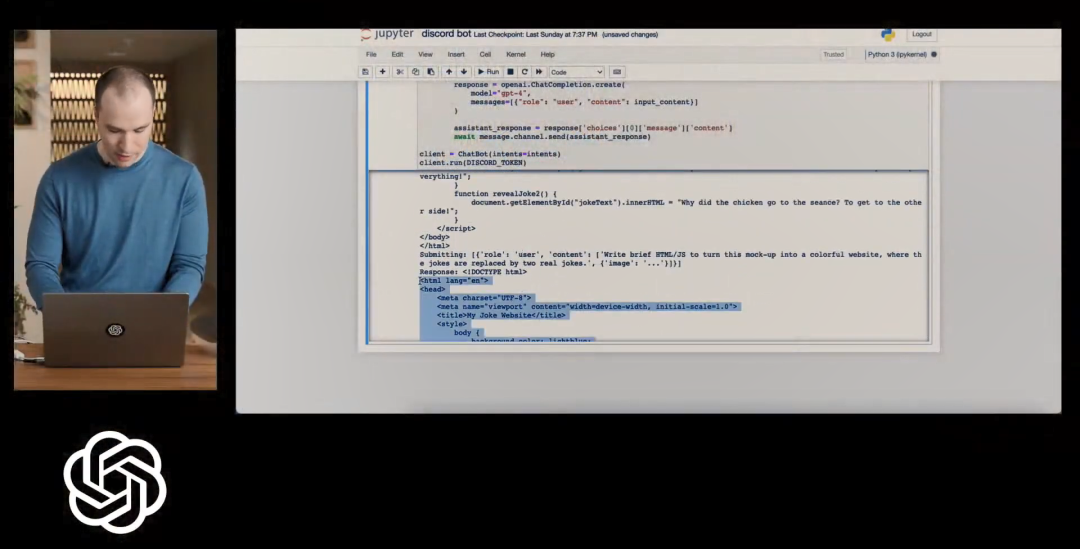

步骤三:将照片发给GPT-4模型,并给出要求:Write brief HTML/JS to turn this mock-up into a colorful website, where the jokes are replaced by two real jokes.

如图所示是GPT-4对提问者提问文本的理解。

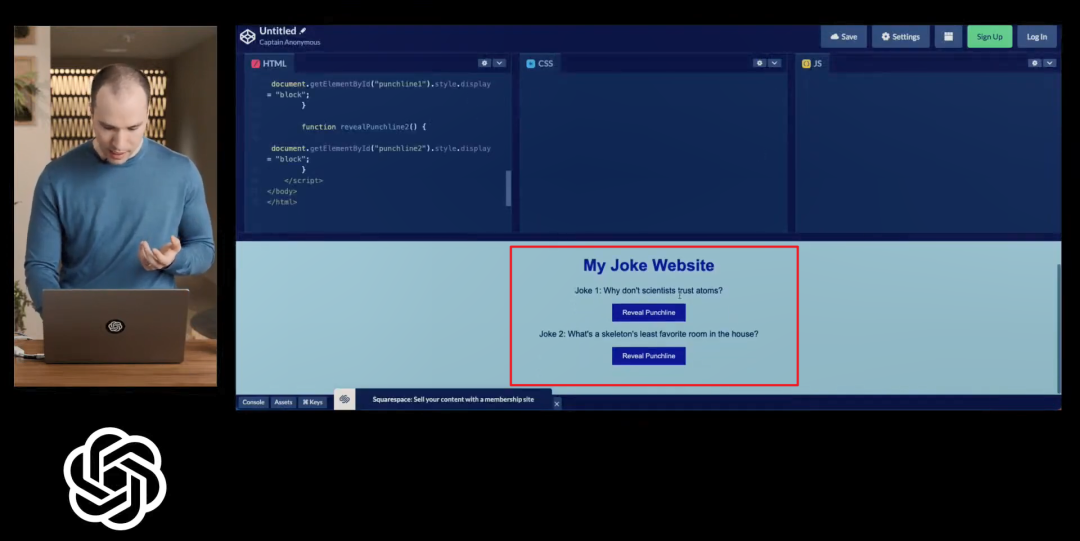

步骤四:将GPT-4回答出的代码,复制粘贴至编程软件并运行。

如下图所示My Joke Website网站就出来了。

关于图像理解能力,其实我们平时使用Edge 侧边栏的Bing Chat 也可以识别文章中的图片,并做出解释,有着自己的理解。

而这次新能力则是应用场景更加广泛,毕竟直接拍照上传图片还是非常nice的。

官方视频:

文献参考:

ChatGPT can now see, hear, and speakGPT-4 发布,ChatGPT 迎来大升级!GPT-4和 New Bing 阅读理解大比拼:哪一个更强? |